智元机器人发布突破性通用基座模型GO-1,引领具身智能新纪元

在机器人技术的前沿探索中,智元机器人近日震撼发布了其首个通用具身基座模型——智元启元大模型Genie Operator-1(简称GO-1)。该模型的问世,标志着具身智能领域迈入了一个全新的发展阶段。

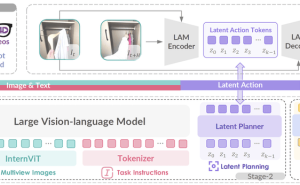

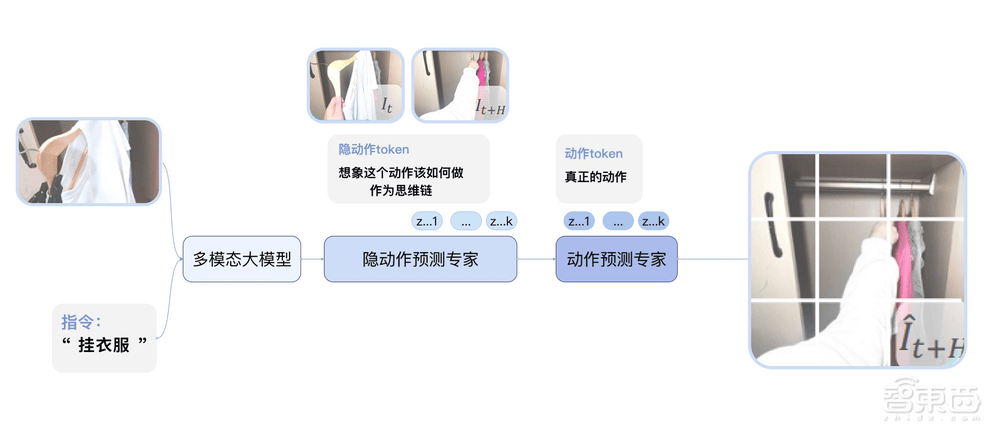

GO-1的核心在于其创新的Vision-Language-Latent-Action(ViLLA)框架,该框架融合了VLM(多模态大模型)与MoE(混合专家)技术。这一组合不仅赋予了GO-1强大的场景感知与理解能力,还使其具备了小样本快速泛化、跨本体应用及持续进化的独特优势。

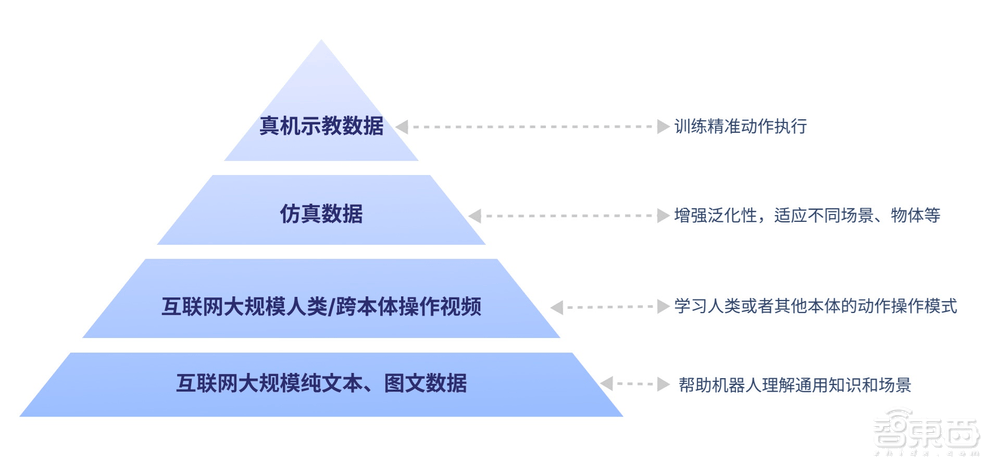

VLM作为GO-1的主干网络,通过继承开源多模态大模型的权重,并利用互联网大规模纯文本和图文数据,实现了对通用知识和场景的深刻理解。而MoE中的隐动作专家模型和动作专家模型,则分别通过学习互联网上的大规模人类操作和跨本体操作视频,以及高质量的仿真数据和真机数据,让GO-1具备了动作的理解与精细执行能力。

GO-1的五大特点尤为引人注目:采训推一体化设计,确保了数据采集、模型训练与推理的无缝衔接;小样本快速泛化能力,使其在极少数据甚至零样本下也能迅速适应新场景与新任务;一脑多形特性,意味着GO-1能够轻松迁移至不同机器人形态,实现跨本体应用;持续进化机制,依托智元的数据回流系统,使GO-1能从实际执行中遇到的问题数据中不断学习与进化;人类视频学习能力,则进一步增强了模型对人类行为的理解。

在构建过程中,GO-1基于具身领域的数字金字塔结构,吸纳了海量知识数据。从底层的大规模纯文本与图文数据,到人类操作/跨本体视频、仿真数据,再到顶层的真机示教数据,每一层都为GO-1的全面“基础教育”与“能力培训”奠定了坚实基础。这使得GO-1能够轻松面对多种多样的环境和物体,快速学习并执行新操作。

ViLLA框架的引入,更是让GO-1实现了从多相机视觉信号与人类语言指令到机器人动作执行的直接输出。与Vision-Language-Action(VLA)模型相比,ViLLA通过预测隐式动作标记,有效弥合了图像-文本输入与机器人执行动作之间的鸿沟。例如,当用户以日常语言向GO-1发出“挂衣服”的指令时,模型能够迅速理解指令含义,拆解任务步骤,并精准完成整个挂衣过程。

GO-1的广泛应用场景同样令人瞩目。从家庭场景中的准备餐食、收拾桌面,到办公和商业场景中的接待访客、发放物品,再到工业等领域的复杂操作任务,GO-1都能迅速适应并高效完成。GO-1还能通过数据回流机制持续进化,不断提升其执行任务的能力与效率。例如,当机器人在制作咖啡时因操作不当导致杯子放歪时,GO-1能从这次失败中学习并调整策略,直至成功完成任务。