近期,AI技术在带来便捷与创新的同时,也引发了社会对其潜在风险的广泛关注。全国政协委员靳东与全国人大代表雷军,两位在各自领域内颇有影响力的公众人物,都不约而同地成为了AI换脸拟声技术的“受害者”,这一事件将AI技术的监管问题推向了风口浪尖。

在政协小组讨论中,靳东提及了一些粉丝因AI换脸视频遭受诈骗的情况,他表示这类行为性质恶劣,呼吁建立更为严格的监管规则。无独有偶,雷军也针对“AI换脸拟声”技术的滥用,提交了加强治理的建议。两位名人的遭遇,揭示了AI技术被不法分子利用进行诈骗和恶意传播的严峻现实。

据报道,靳东的粉丝曾遭遇诈骗团伙利用AI技术伪造其声音和形象,诱导粉丝进行投资或捐款。而雷军则因AI配音视频在网络上被恶意谩骂,相关话题视频的播放量高达1.2亿次,影响恶劣。这些事件不仅损害了公众人物的声誉,更揭示了AI技术在缺乏有效监管下可能带来的社会危害。

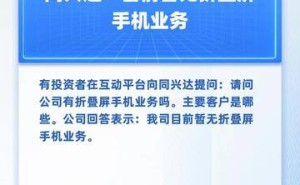

随着AI技术的飞速发展,其应用场景日益丰富,深刻改变了人们的生活方式。然而,这也使得网络信息变得更加复杂难辨。不法分子利用AI生成工具,制作虚假图片、录音和视频,混淆视听,甚至进行诈骗等违法活动。这一现象的泛滥,对网络安全和个人隐私构成了严重威胁。

为了应对这一挑战,国家已经出台了一系列法律法规,如《互联网信息服务深度合成管理规定》和《生成式人工智能服务管理暂行办法》。这些规定明确要求,任何组织和个人不得利用深度合成服务制作、传播违法信息,从事危害国家安全、损害公共利益等活动。同时,国家也鼓励AI技术的创新发展,但强调必须在法律框架内进行。

加强AI技术的监管,不仅是为了保护个人的隐私和权益,更是为了维护整个行业的健康发展。靳东和雷军的遭遇,暴露了当前AI技术在管理和审核方面的不足。一些AI生成软件对网络谣言“不设防”,内容平台也往往缺乏必要的审核机制,导致谣言在网络上迅速扩散。

为了改变这一现状,不仅需要加强法治监管,还需要相关各方积极履行职责。AI生成软件应对内容和关键词进行严格审核,确保生成内容的合法性和真实性。内容平台则应加强日常巡查,建立畅通的举报机制,及时阻断问题内容的传播。只有这样,才能构建一个安全、健康的网络环境,促进AI技术的健康发展。