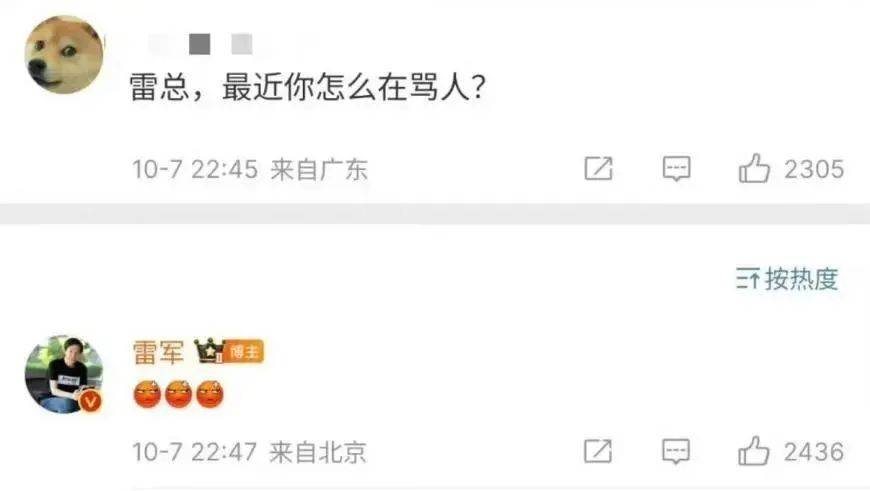

近期,网络上兴起了一股利用AI技术深度合成音视频的风潮,引发了社会各界的广泛关注。这股风潮中,小米公司CEO雷军意外“现身”多个短视频平台,针对堵车、假期安排、游戏等热门话题发表了一系列言辞犀利的评论,甚至夹杂不文明语言,一时间引起了网友的热议。

然而,经核实,这些视频中的声音并非雷军本人所出,而是借助先进的AI技术生成的配音。这一发现让不少网友大跌眼镜,同时也引发了对于AI技术滥用的担忧。

不仅如此,网络上还出现了“张文宏医生”推销蛋白棒的音视频,由于口型和声音与张文宏本人高度相似,导致部分老年人误信并下单购买。张文宏医生对此表示无奈,并向平台方投诉,称自己也曾考虑报警,但对方账号频繁更换且均为虚拟身份,难以追踪。

更令人震惊的是,不法分子也开始利用AI深度合成技术制作虚假音视频进行诈骗。他们通过模仿名人亲属的声音,实施精准诈骗,让不少受害者上当受骗。多位配音演员也发声称,自己的声音被AI“盗用”,用于制作各种虚假音视频。

央视新闻近日对这一现象进行了深入报道,指出AI深度合成音视频技术的滥用已经成为一个不容忽视的社会问题。据报道,去年3月,刘德华电影公司就曾发布声明,称有网友利用AI技术合成的刘德华声音进行虚假宣传,骗取演唱会门票订金。

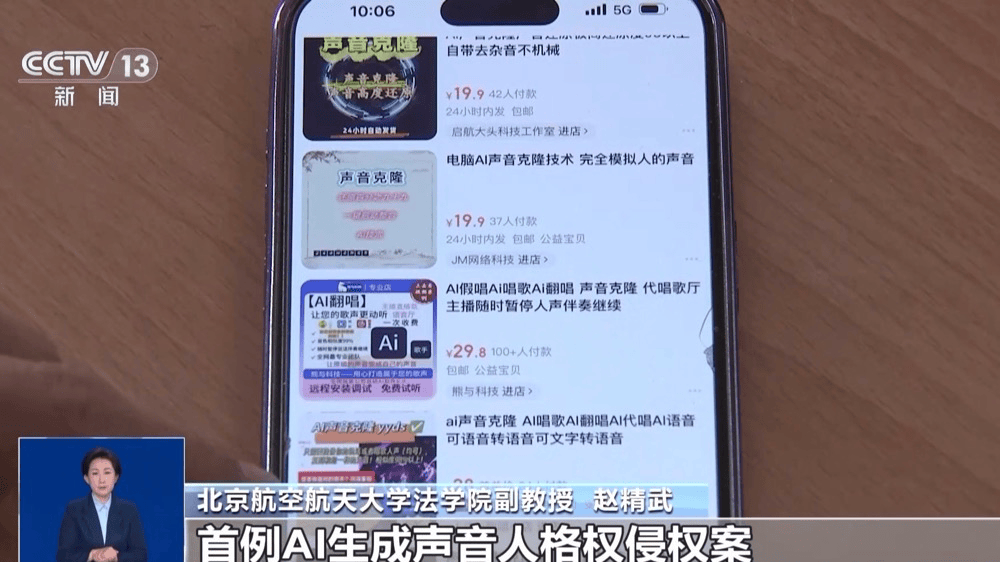

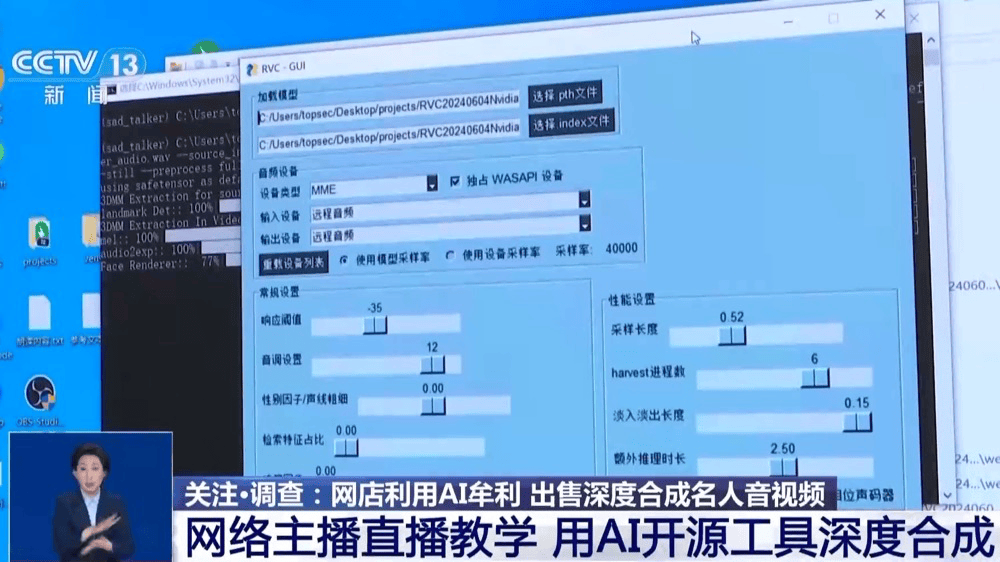

调查还发现,在一些购物平台上,AI深度合成技术已经成为众多网店牟利的工具。只需花费几十元,就可以定制AI深度合成的名人音视频。这些软件和工具虽然有一定的技术门槛,但随着算法的不断迭代升级,如今已经能够生成“真假难辨”的音视频内容。

值得注意的是,相关法律法规已经明确规定,未经授权,不得深度合成制作发布他人信息。然而,这些网店接单制作名人音视频的行为已经构成了侵权,并应承担相应的法律责任。不仅是名人,普通人甚至动画形象,如果未经本人或版权方同意,就被用于AI合成制作音视频,同样构成侵权行为。

面对这一乱象,专家呼吁相关部门应加强监管力度,打击利用AI技术进行侵权和诈骗的行为。同时,广大网民也应提高警惕,避免上当受骗。