近年来,AI深度合成技术在网络空间引发了诸多争议,从恶搞企业家雷军,到冒充张文宏医生进行带货,再到利用该技术实施诈骗,侵权现象层出不穷。

其中,一起引人注目的案例是,有网友利用AI技术模仿刘德华的声音,企图吸引流量。刘德华的电影公司迅速发布声明,提醒公众警惕伪造刘德华声音的AI语音合成技术骗局。记者深入调查发现,AI深度合成音视频的制作门槛并不高,甚至在一些网购平台上,该技术已成为不少网店牟利的工具,只需花费少量金钱,就能定制名人AI深度合成音视频。

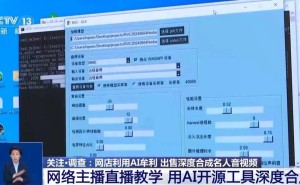

那么,这些高度逼真的AI合成音视频是如何制作出来的呢?记者发现,尽管一些换脸工具在网络上容易下载,但效果往往不够逼真。专家指出,当前网络上有众多开源软件和工具,能够实现换声和换脸效果,供网民自由下载和使用。这些软件虽然有一定的技术门槛,但已有不少网络主播在短视频平台上直播教学,教授如何使用这些工具。

针对这一现象,中国网络空间安全协会人工智能安全治理专业委员会的专家表示,尽管这些软件种类繁多,但都属于半专业软件,需要调整参数和步骤较多。然而,随着这些软件在短视频平台上的普及,越来越多的网民开始掌握这些技术。

那么,网购平台上使用AI深度合成技术制作并出售名人音视频,是否触犯法律呢?专家明确指出,相关法律法规明确规定,未经授权,不得深度合成制作发布他人信息。因此,网店接单制作名人AI音视频的行为,已经构成侵权,并应承担相应的法律责任。

在司法实践中,国内已经审结了首例AI生成声音人格权侵权案。该案中,一位配音演员的声音在未经授权的情况下,被AI生成并对外出售。法院最终认定被告方构成侵权,并判决其书面赔礼道歉,赔偿原告各项损失25万元。这一案例为类似侵权行为提供了法律参考。

对于如何防范AI深度合成音视频侵权问题,专家建议从多个层面入手。从技术角度来看,可以利用AI技术来对抗和检测AI。目前已有一些典型的AI技术能够对图片或音视频进行检测,判断其是否经过后期加工和合成。同时,法律层面也应进一步完善相关立法,细化AI克隆技术的法律条款,明确侵权行为的定义和责任,并加强执法力度。

平台方面也应承担起责任,强化相关政策法规的宣贯和执行,做好已有数据的保护,应用技术手段来规避AI克隆侵权问题的发生。还应建立健全内容审核和侵权举报机制,及时发现和处理侵权问题。

最后,法律专家提醒AI深度合成制作和信息发布者,不要心存侥幸。法律没有灰色地带,任何不合法、不合理的使用AI合成技术的行为都将受到法律的制裁。正如一位专家所言:“法律并不是禁止使用AI合成技术,而是禁止不合法不合理的使用,尤其是禁止不进行任何显著标识和提示的AI合成信息的发布和传播。”