近日,即梦AI在其官方社交平台上震撼发布了一则关于全新功能预告的视频,揭开了多模态视频生成模型OmniHuman的神秘面纱。该模型仅凭一张图片与一段音频,便能自动生成富有生命力的AI视频,预示着AI短片制作将迎来效率与质量的双重飞跃。

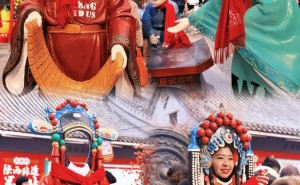

据OmniHuman技术介绍页面显示,这款由字节跳动自主研发的闭源模型,能够接纳肖像、半身乃至全身等多种尺寸的图片输入。结合音频信息,它能让视频中的人物动作与音频完美同步,无论是演讲、歌唱、乐器演奏还是行走,都显得栩栩如生。尤为OmniHuman在解决人物视频生成中常见的手势不自然现象上,相较于现有技术有了显著提升。该模型对非真人图片,如动漫、3D卡通等同样表现出色,生成的视频能完美保留其独特风格与原有运动模式。

从技术演示效果来看,OmniHuman所生成的视频已具备高度的自然流畅感。为防止技术滥用,字节跳动技术团队明确指出,OmniHuman将不会对外开放下载。

即梦AI相关负责人表示,尽管OmniHuman目前的表现已相当出色,但在生成接近影视真实级别的视频方面,仍有待进一步提升。为此,该模型所支持的多模态视频生成功能将首先在即梦平台上进行小范围内测,以便进行细致调优,并逐步扩大开放范围。同时,即梦AI将对此功能实施严格的安全审核机制,并对生成的视频添加水印作为警示,旨在确保AI技术的正面应用,助力视频创作者更好地实现创意表达。