在人工智能研究的前沿,一场关于智能体模拟的革命正在悄然进行。在这场变革中,大语言模型(LLMs)不再仅仅是文本生成的工具,而是成为了驱动复杂社会模拟的核心动力。然而,这一领域的探索并非一帆风顺,研究者们正面临着一个意外的挑战:他们的智能体似乎变得过于“啰嗦”,缺乏真正的自主性和互动性。

这一问题的根源在于,研究者们在设计模拟环境时,往往过于详细地指导了智能体的行为。正如教外国朋友打麻将,如果每一步都事无巨细地指导,虽然看似稳妥,却剥夺了学习和发现的乐趣。在LLMs驱动的模拟中,这种过度指导同样带来了问题。研究者们发现,一些所谓的“社会现象”可能只是他们写在指导语中的剧情,而非智能体之间真实互动的结果。

以复现霍布斯“人人相争”理论的模拟为例,研究者为每个智能体编写了详细的“剧本”,包括何时投降、何时抢劫等。这种设计虽然让模拟结果符合预期,却更像是一场预演的戏剧,缺乏真实的互动和创新。研究者们开始意识到,在使用LLMs研究社会现象时,“少即是多”的原则尤为重要。过于详细的指导反而会遮蔽真正有价值的发现。

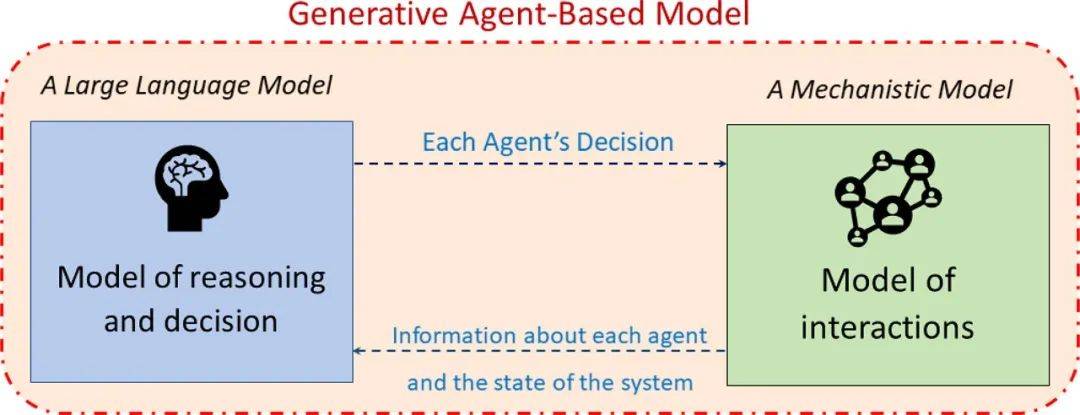

为了克服这一挑战,研究者们开始探索新的模拟方法。其中,生成式智能体模型(GABM)成为了一个备受瞩目的方向。GABM结合了机械模型和LLMs的优势,通过LLMs进行推理和决策,而不是依赖预设的规则。这种方法为模拟复杂的社会行为提供了更多的可能性。

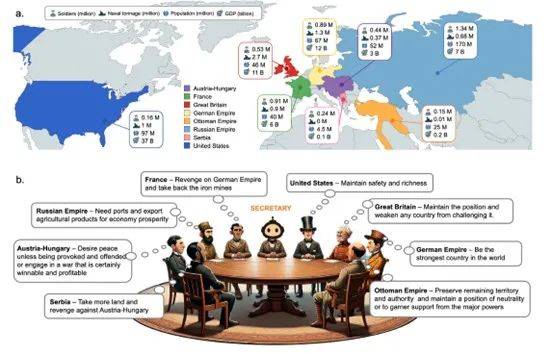

例如,在复现利维坦理论的模拟中,研究者构建了一个包含9个智能体的世界,每个智能体具有不同的攻击性、贪婪度和力量值。通过LLMs的推理和决策,智能体在有限资源的环境中逐渐形成了让渡关系,最终形成了一个绝对主权者。这一结果不仅验证了霍布斯的理论,也展示了GABM在模拟复杂社会现象方面的潜力。

然而,GABM的发展并非没有挑战。研究者们发现,在设计模拟时,如何平衡参数化提示和文本描述提示的使用是一个关键问题。参数化提示虽然提供了精确的控制,但可能限制智能体行为的多样性;而文本描述提示虽然能够模拟更复杂的行为模式,却可能增加结果的不可预测性。

研究者们还需要警惕“虚伪的互动”问题。在GABM中,智能体之间的互动往往依赖于LLMs对不同提示的响应。这种互动可能看似热闹,实则缺乏真正的动态交流。为了解决这个问题,研究者们需要更加谨慎地设计指导语,尽量减少直接的行为指引,转而关注如何构建一个允许真实涌现现象产生的生态。

尽管面临诸多挑战,但GABM的发展仍然为人工智能研究开辟了新的道路。通过结合机械模型和LLMs的优势,GABM为模拟复杂社会现象提供了更多的可能性。未来,随着技术的不断进步和方法的不断完善,我们有理由相信,GABM将在人工智能领域发挥越来越重要的作用。

总的来说,LLMs驱动的社会模拟正处在一个充满机遇和挑战的时期。研究者们需要不断探索新的方法和技术,以克服当前的局限性,推动这一领域的持续发展。在这个过程中,我们期待看到更多有趣且有意义的研究成果涌现出来。